Le regole europee sull’intelligenza artificiale

Da agosto è in vigore l’AI Act, regolamento che normerà l’utilizzo di strumenti come ChatGPT

Ciao!

Io sono Vincenzo Genovese e questa è Spinelli, la newsletter settimanale di Will che racconta l’Unione europea da Bruxelles.

Giovedì 1 agosto è entrato in vigore il “Regolamento sull’intelligenza artificiale”, noto come AI Act, che era stato concordato da Consiglio e Parlamento europeo a fine 2023 e poi definitivamente approvato a febbraio e marzo 2024 dalle due istituzioni.

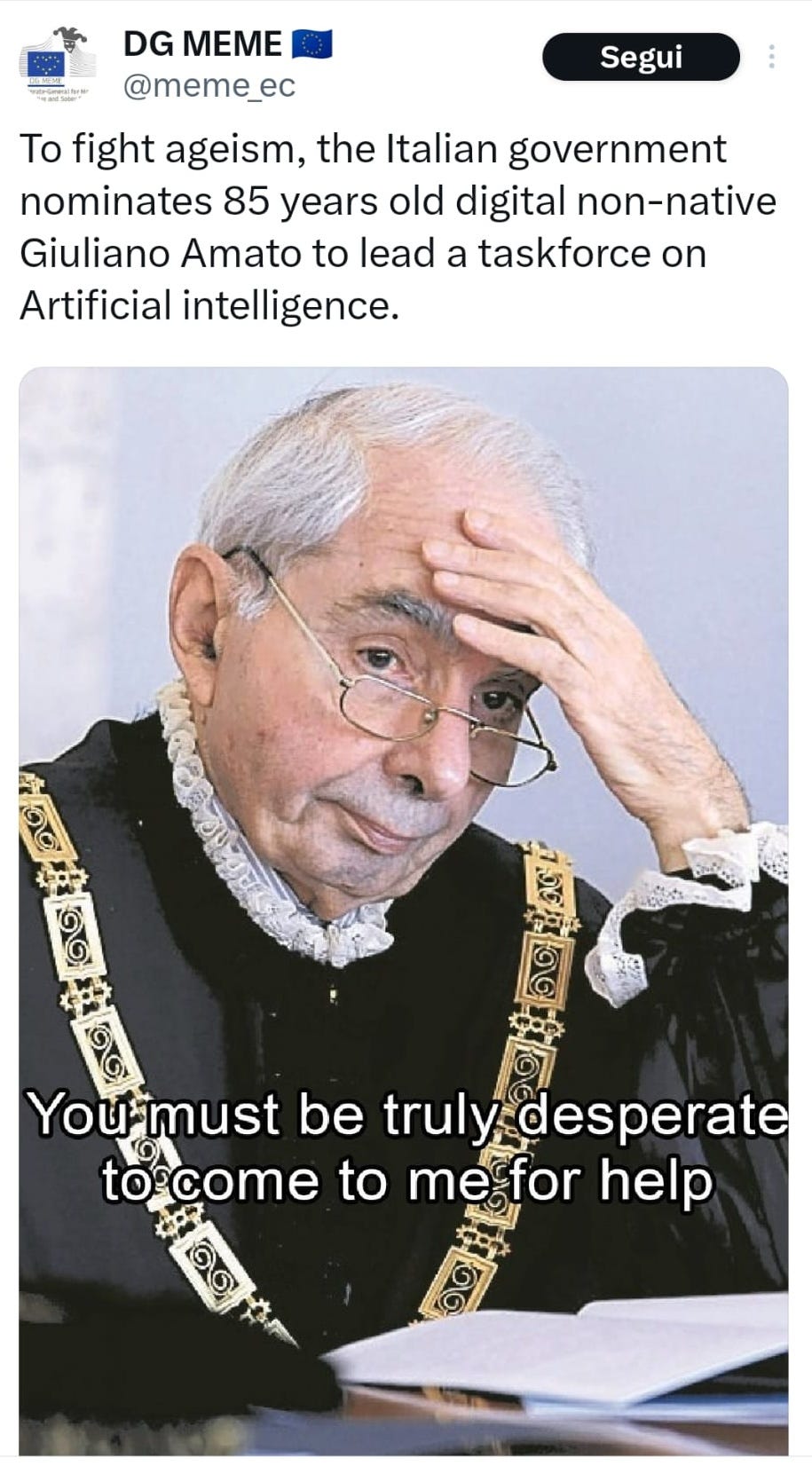

A ottobre 2023 il costituzionalista 85enne Giuliano Amato era stato nominato in Italia presidente di una commissione sull’intelligenza artificiale nel campo dell'editoria, scelta che aveva suscitato parecchia ironia. Amato presentò poi le dimissioni all’inizio del 2024.

Si tratta di una legge unica nel suo genere, perché è la prima al mondo a regolamentare l’utilizzo di sistemi di intelligenza artificiale, molti dei quali sono ancora in fase di sviluppo. L’approccio del regolamento è basato sui rischi derivanti da ogni strumento: per alcuni sistemi di AI basta rispettare i requisiti di trasparenza; per altri sono necessarie salvaguardie maggiori; altri ancora presentano rischi così elevati da essere vietati sul territorio dell’Unione europea.

🕓 Questa newsletter oggi conta 1.315 parole e si legge tutta in 6 minuti.

🚫 Le applicazioni di intelligenza artificiale vietate nell’UE

La lista delle pratiche di intelligenza artificiale messe al bando è contenuta nell’articolo 5 del regolamento. Le aziende che li impiegano devono smettere di farlo entro sei mesi dall’entrata in vigore della legge (2 febbraio 2025), pena sanzioni amministrative fino a 35 milioni di euro o al 7% del fatturato globale annuo della stessa azienda.

Tra le pratiche proibite ci sono quelle che impiegano tecniche subliminali, manipolative o ingannevoli o che sfruttano disabilità o debolezze delle persone. Ma anche quelle di “social scoring”, che attribuiscono punteggi sulla base dei comportamenti di un individuo. O quelli sulla cosiddetta giustizia predittiva, che valutano le probabilità che qualcuno commetta un reato unicamente analizzandone i tratti della personalità. Sono vietati pure quei sistemi che permettono di cogliere le emozioni di una persona, se utilizzati “nell'ambito del luogo di lavoro e degli istituti di istruzione”.

Un punto importante riguarda l’identificazione biometrica, cioè quei sistemi come il riconoscimento facciale che servono a stabilire l’identità delle persone. Un esempio noto sono i macchinari che sempre più spesso controllano i passaporti negli aeroporti.

Questi strumenti svolgono un'identificazione biometrica “in tempo reale”, che secondo l’AI Act sarà permessa solo in alcuni casi precisi, oltre alla conferma di un documento di identità: la ricerca di persone scomparse, vittime di tratta o sfruttamento di esseri umani; la prevenzione di un attacco terroristico o comunque di una “minaccia reale e prevedibile” o l’identificazione di persone sospettate di aver commesso reati gravi (con pene dai quattro anni di carcere in su). In ognuno di questi casi, è necessaria comunque un’autorizzazione preventiva rilasciata da un’autorità giudiziaria.

Ciò significa che in luoghi pubblici non sarà possibile identificare le persone in tempo reale tramite l’AI, né creare database utilizzando le immagini riprese dalle telecamere di videosorveglianza.

La pubblicità personalizzata sulla base del riconoscimento facciale, immaginata in un futuro distopico da Steven Spielberg nel film Minority Report del 2002, non sarà autorizzata nell’UE.

⚠️ Gli strumenti di AI ad “alto rischio”

Le stesse immagini riprese dalle telecamere di sorveglianza in luoghi pubblici potrebbero essere in alcuni casi utilizzate per quella che viene definita “identificazione biometrica in differita”, cioè effettuata a distanza di tempo da quando le riprese sono state svolte.

È uno dei casi di “sistemi ad alto rischio”, che presentano cioè un “rischio significativo di danno per la salute, la sicurezza o i diritti fondamentali delle persone fisiche”. Non sono completamente vietati, ma devono rispettare stringenti parametri di sicurezza per essere impiegati, come la conservazione delle registrazioni o la presenza di una sorveglianza umana finale. A stabilirli nello specifico sarà la Commissione europea entro il 2 febbraio 2026.

L’elenco dei sistemi ad alto rischio, che la Commissione deve rivedere e aggiornare periodicamente, è molto lungo e prevede fra gli altri:

sistemi utilizzati come componenti di sicurezza nelle infrastrutture digitali (traffico stradale, fornitura di acqua, gas, riscaldamento o elettricità)

sistemi destinati a determinare l’ammissione agli istituti di istruzione e formazione professionale, i risultati dell’apprendimento o i comportamenti vietati degli studenti durante le prove

sistemi utilizzati per l’assunzione o la selezione di lavoratori o per assegnare loro compiti sulla base del comportamento individuale

sistemi impiegati nel contesto del controllo delle frontiere per individuare, riconoscere o identificare le persone fisiche, a eccezione della verifica dei documenti di viaggio

Gli obblighi previsti dal regolamento per questi strumenti “ad alto rischio” si applicano a decorrere dal 2 agosto 2027 e le sanzioni arrivano fino a 15 milioni di euro o al 3% del fatturato mondiale annuo di un’azienda che non rispetta le regole.

🔎 La trasparenza necessaria per l’intelligenza artificiale

Per tutti quegli altri strumenti di intelligenza artificiale che non presentano un rischio alto, è comunque richiesto il rispetto di alcune norme generali di trasparenza.

Sono i cosiddetti “general-purpose AI systems”, modelli in grado di assolvere molti compiti differenti. Tra questi rientrano anche i programmi di “intelligenza artificiale generativa”, che possono cioè produrre testi, immagini, video e suoni difficilmente distinguibili da quelli realizzati da una persona umana: gli esempi più famosi sono ChatGPT della società Open Ai e Gemini di Google.

Tali modelli devono rispettare le leggi europee sul copyright e rendere disponibili elenchi dettagliati delle fonti utilizzate come database per le proprie risposte. Inoltre, ogni immagine artificiale o manipolata (i cosiddetti “deepfake”) deve essere chiaramente etichettata come tale.

I produttori di questi strumenti sono obbligati a redigere e aggiornare una “documentazione tecnica del modello”, che ne consenta una comprensione delle capacità e dei limiti, e a collaborare con le autorità per le verifiche necessarie. Per adeguarsi a queste regole ci sarà tempo fino all’anno prossimo (2 agosto 2025), e le multe arrivano fino a 15 milioni di euro o al 3% del fatturato globale annuo.

Dall’AI Act restano invece esclusi tutti quei sistemi di intelligenza artificiale utilizzati esclusivamente per scopi di ricerca scientifica, militari o di difesa. In questi campi la legislazione è molto più permissiva.

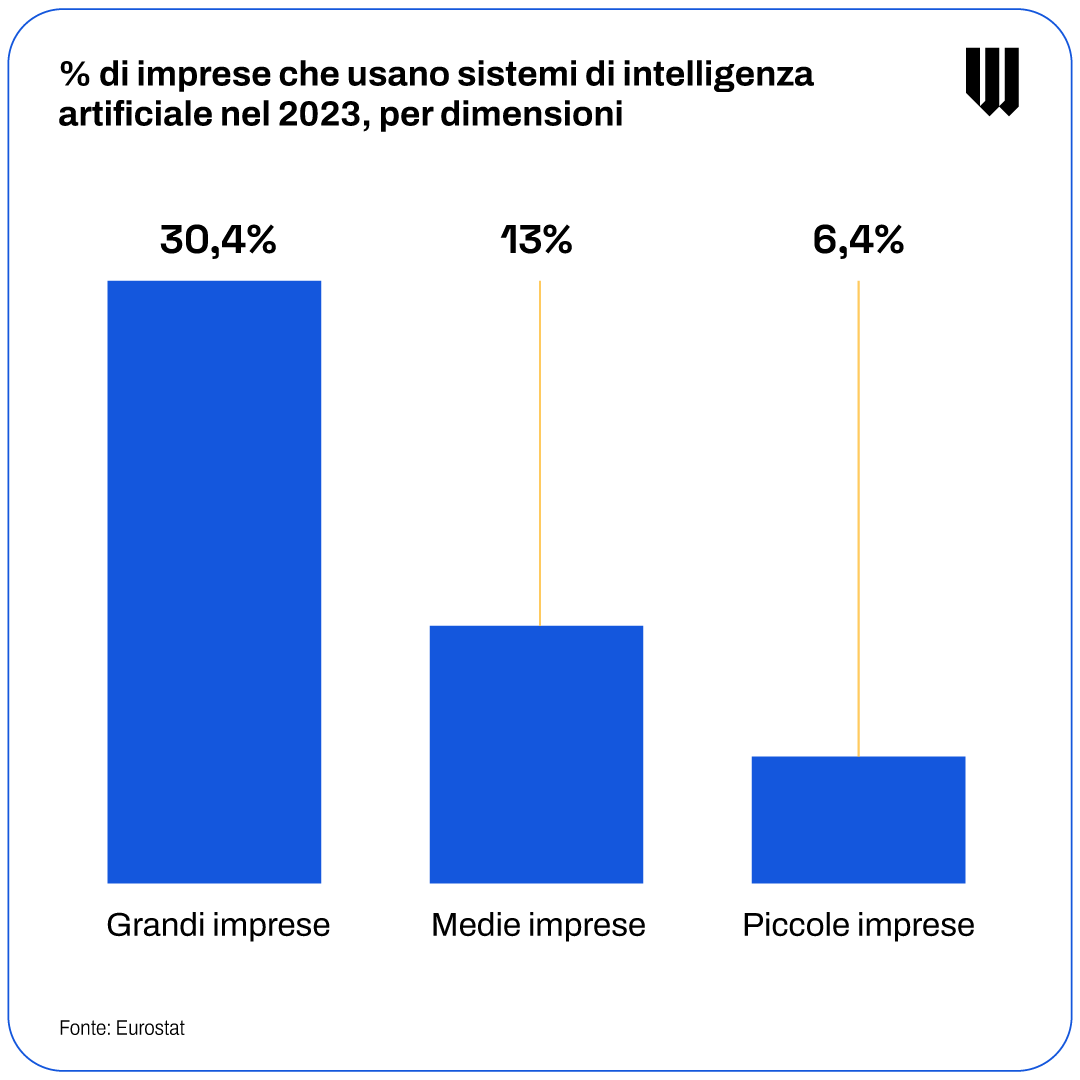

🤖 Solo il 6% delle piccole imprese fa uso di sistemi di intelligenza artificiale

🎙️ Di come l’AI tra trasformando le aziende italiane, dell’hype intorno a questa tecnologia e di come è possibile rimanere al passo con un mondo del lavoro in così rapida evoluzione abbiamo parlato in questa puntata di Actually, il nostro podcast in cui raccontiamo i grandi cambiamenti del mondo👇

🏛️ Il museo 3D e i fondi di coesione

In un mondo sempre più virtuale, anche i musei lo sono. È il caso del MuDeFri, il Museo del Design del Friuli-Venezia Giulia: un visore permette di visitare le mostre in 3D, all’interno di uno show-room digitale disegnato da un architetto, osservando oggetti reali ricreati al computer grazie a un’accurata ricostruzione filologica. Il progetto di sviluppo di questo museo è stato finanziato dalla politica di coesione, italiana ed europea, con un finanziamento complessivo di 63mila euro.

Come sai, Will è in primis una community di persone che vuole prendere parte al cambiamento. Anche noi vogliamo prendere parte al cambiamento, e per fare questo conoscere cosa pensa la community del nostro lavoro è fondamentale 👇

Abbiamo fatto questo sondaggio per chiederti cosa ti piace di Will, cosa possiamo fare per migliorare e altre domande per migliorare il nostro lavoro: se ti va di dedicarci un po’ del tuo tempo te ne saremo molto grati (e ci sarà un regalo per te 🎁)!

Il motto della nostra community è sempre stato prendi parte al futuro. Da oggi anche tu puoi prendere al futuro di Will sostenendoci direttamente, tramite il nostro programma di membership: questa newsletter e tutti gli altri contenuti che hai sempre trovato su Will continueranno a essere gratuiti, ma potrai accedere a nuovi podcast, newsletter dedicate e approfondimenti speciali a cura del nostro team 👇

Seguici su nostri canali:

Instagram - TikTok - Youtube - Facebook - LinkedIn - Whatsapp - Telegram

🎙️ Ascolta i nostri podcast